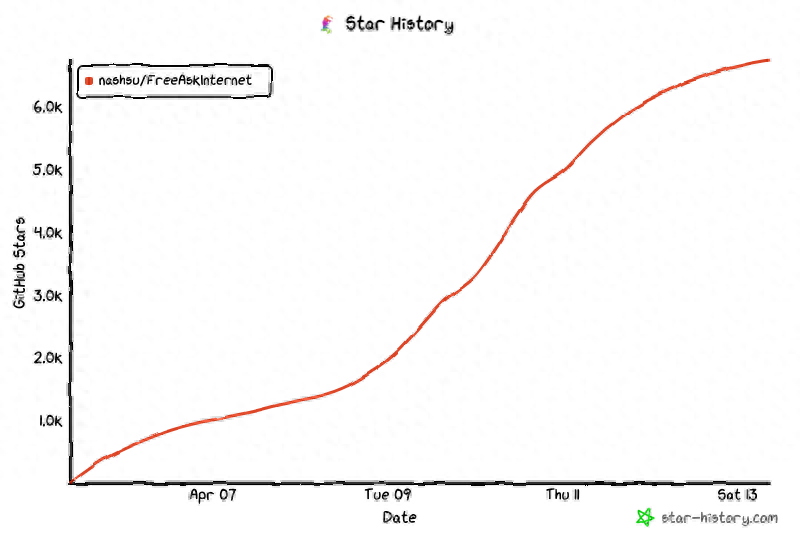

AI搜索領域,最近比較火的一個github開源項目:FreeAskInternet,該項目是2024年4月5日開源,短短一周,已經漲到了6.8k star。

這里說下怎么在github上查看某個項目的開源時間:

https://api.github.com/repos/{:owner}/{:repository},替換{:owner}和{:repository}為對應的用戶名和倉庫名即可。如:https://api.github.com/repos/nashsu/FreeAskInternet

什么是FreeAskInternet?

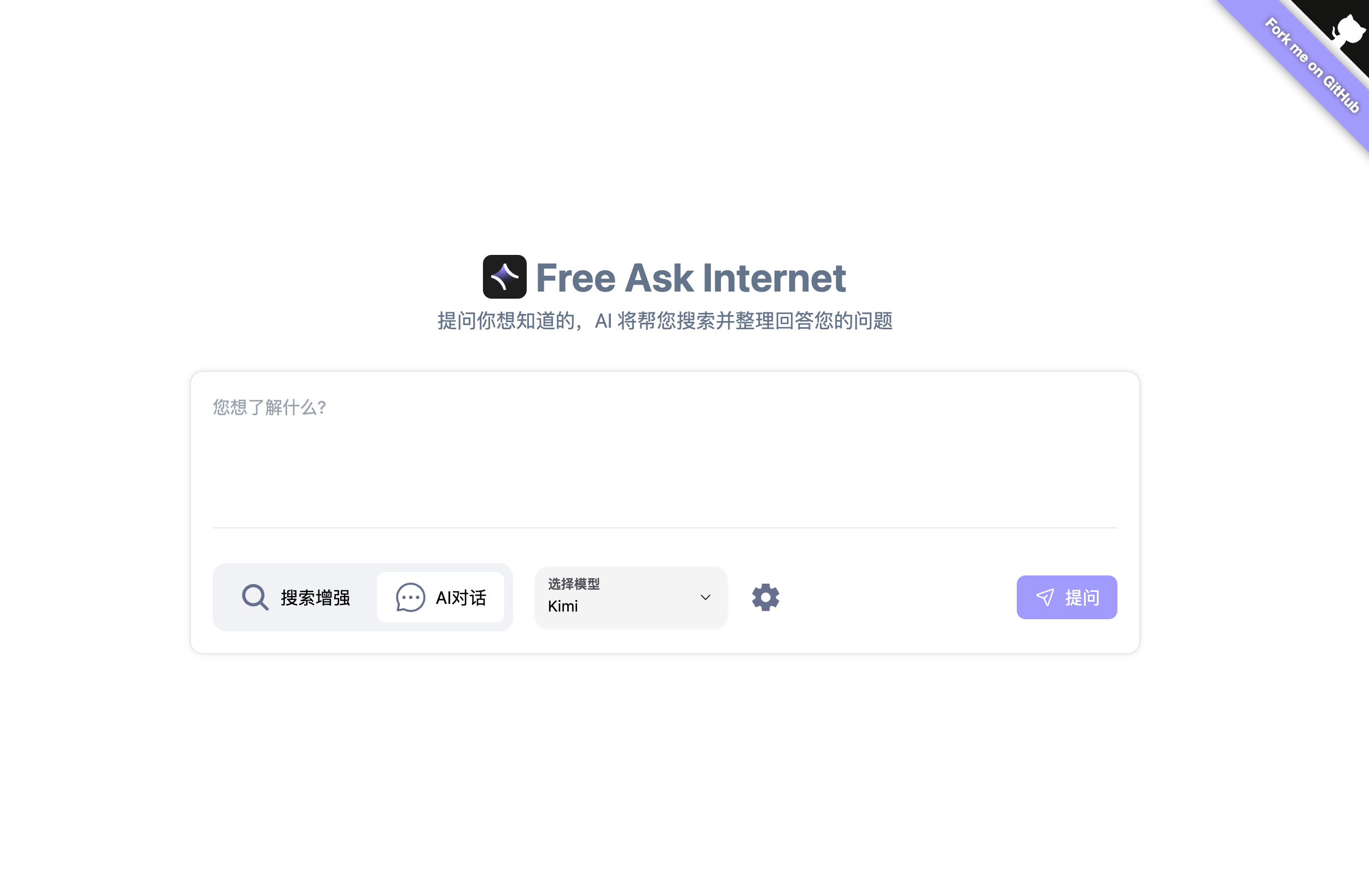

FreeAskInternet 是一個完全免費、私有且本地運行的搜索聚合器,并使用 MULTI LLM 生成答案,無需GPU。用戶可以提出問題,系統將進行多引擎搜索,并將搜索結果合并到LLM中,并根據搜索結果生成答案,全部免費使用。

FreeAskInternet有哪些特征?

- ?完全免費(不需要任何API密鑰)

- 完全本地化(無需GPU,任何計算機都可以運行)

- 完全私有(所有東西都在本地運行,使用自定義llm)

- 無需 LLM 硬件即可運行(無需 GPU!)

- 使用免費的 ChatGPT3.5 / Qwen / Kimi / ShipuAI(GLM) API(無需 API 密鑰!感謝 OpenAI)

- 定制LLM(ollama,llama.cpp)支持,是的,我們喜歡ollama!

- 使用 Docker Compose 快速輕松地部署

- Web 和移動友好界面,專為 Web 搜索增強的 AI 聊天而設計,允許從任何設備輕松訪問。

FreeAskInternet的工作原理是怎樣的?

- 用戶在FreeAskInternet的UI界面(www.perplexity.ai)上輸入問題。

- 系統調用本地運行的searxng,在多個搜索引擎上進行搜索。

- 爬取搜索結果鏈接的內容。

- 將這些搜索結果與ChatGPT3.5 LLM結合,基于搜索結果生成答案

這種多引擎搜索和LLM生成的方式,可以充分利用不同搜索引擎的優勢,提高回答的準確性和全面性,與基于單一LLM的系統不同,FreeAskInternet可以更好地覆蓋各類問題,提供更加可靠的服務,另外,FreeAskInternet是在本地運行的,不需要聯網,可以保護用戶的隱私,避免數據被收集和泄露。

FreeAskInternet本地如何運行?

git clone https://github.com/nashsu/FreeAskInternet.git

cd ./FreeAskInternet

docker-compose up -d 您現在應該能夠在http://localhost:3000上打開 Web 界面。默認情況下不會公開任何其他內容。(對于舊的 Web 界面,訪問 http://localhost:3030)

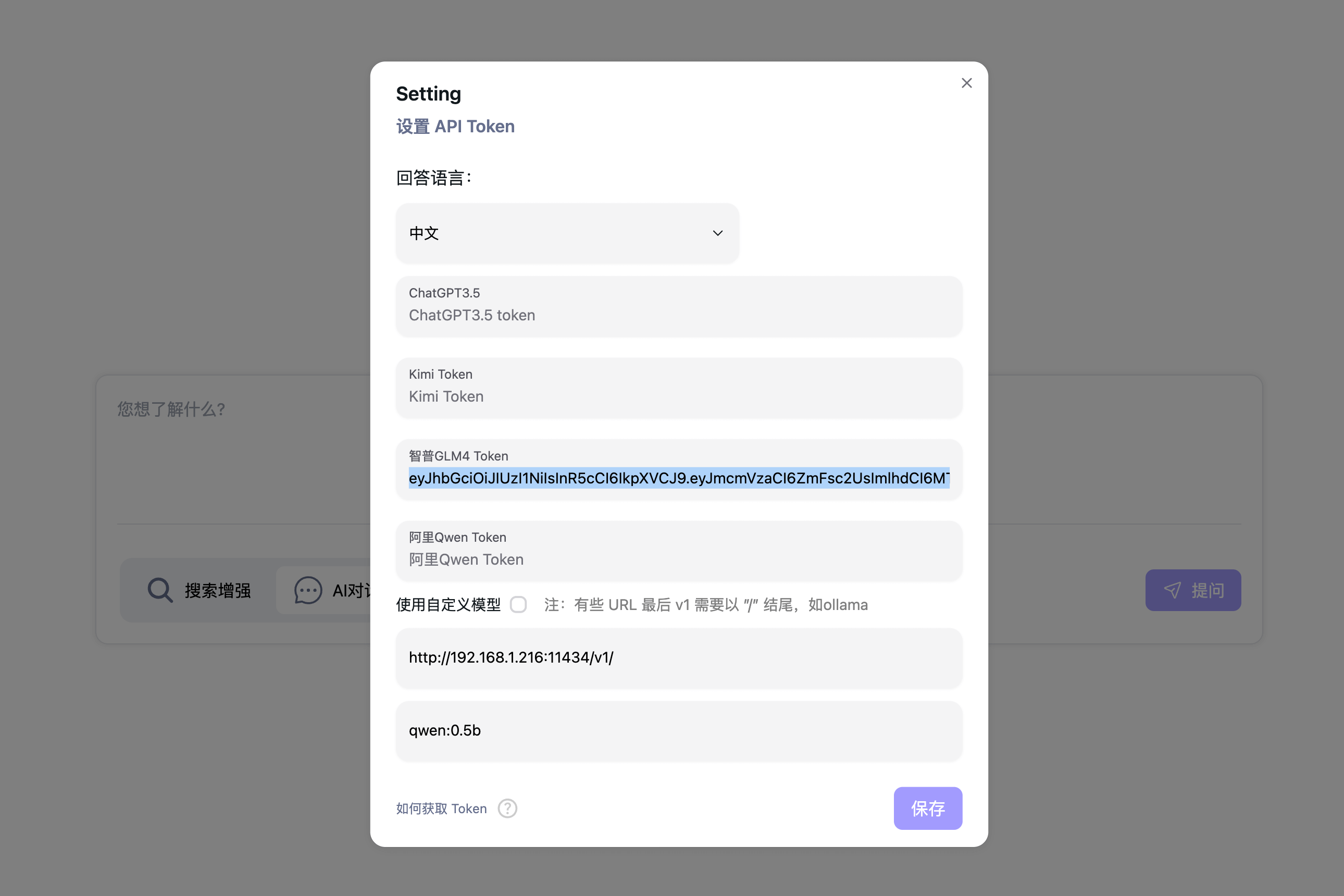

如何獲取和設置Kimi/Qwen/ZhipuAI Token?

如何獲得Token?

使用

https://github.com/LLM-Red-Team項目來提供這些服務,您可以參考他們的自述文件。

參考:

https://github.com/LLM-Red-Team/kimi-free-api

如何使用像ollama這樣的定制LLM?

開始 ollama 服務

export OLLAMA_HOST=0.0.0.0

ollama serve在設置中設置ollama url:您必須使用計算機的IP地址,而不是localhost/127.0.0.1,因為在docker中您無法訪問該地址。模型名稱是您想要 ollama 提供服務的模型。